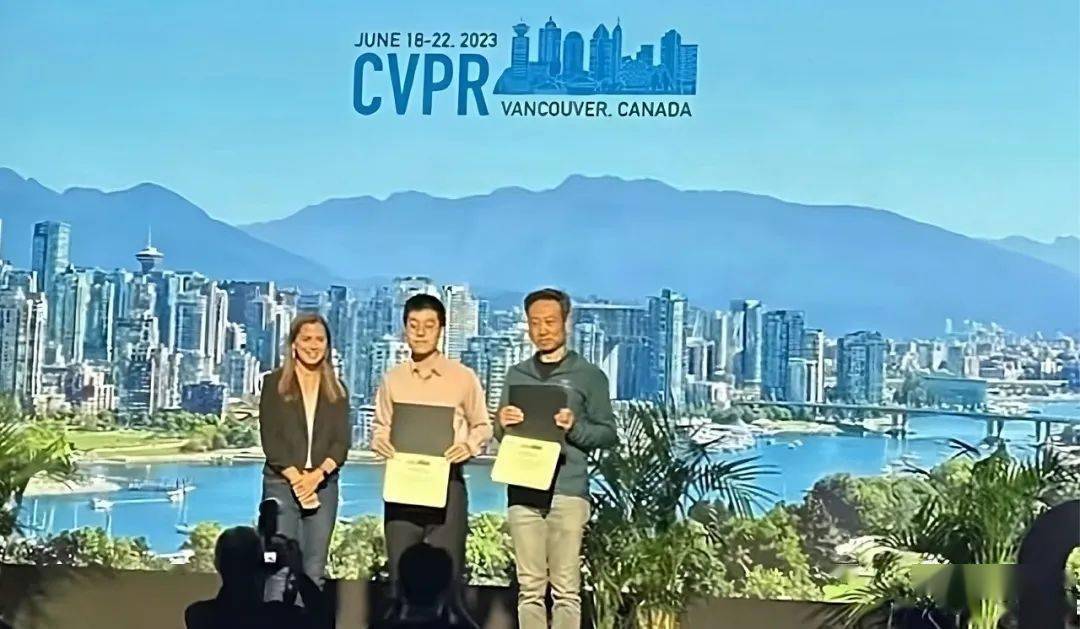

CVPR 2023 即將舉辦,12 篇獲獎論文候選公布,斯坦福大學研究人

更新時間:2024-09-10 07:06:31作者:佚名

今天,官方公布了12篇獲獎論文候選名單。(占接受論文的0.51%和提交論文的0.13%)

根據官網統計,本屆 CVPR 共接受論文 9155 篇,其中錄取 2359 篇,錄取率為 25.8%。

其中 235 篇經過評級。(占已接受論文的 10% 和已提交論文的 2.6%)

1. 通過自我頭部姿勢實現自我身體姿勢

作者:Li, Karen Liu, Wu

院校:斯坦福大學

論文地址:

在本文中,研究人員提出了一種新方法,通過自我頭部姿勢估計來進行自我身體姿勢估計(Ego-Body Pose ),將問題分解為以頭部運動作為中間表示連接的兩個階段。首先,結合SLAM和一種學習方法來估計準確的頭部運動。

隨后薩里大學,利用條件擴散,使用估計的頭部姿勢作為輸入,生成多個合理的全身運動。頭部和身體姿勢的分離消除了對以自我為中心的視頻和 3D 人體運動的配對訓練數據集的需求,使研究人員能夠分別利用大規模以自我為中心的視頻數據集和動作捕捉數據集。

此外,為了對該系統進行基準測試,研究人員開發了一個合成數據集 AMASS-Ego-Syn (ARES),其中包括成對的自我中心視頻和人體動作。在 ARES 和真實數據上,研究人員的模型表現明顯優于目前最先進的方法。

2. 3D 和

作者:張希宇、楊嘉琪、張、張

3. :大型 3D ,和

作者:吳童、張、付曉、王雨馨、任、潘亮、吳、楊雷、王嘉琪、陳茜、林大華、劉紫薇

機構:上海人工智能實驗室、香港中文大學、商湯科技、香港科技大學、南洋理工大學

論文地址:

由于缺乏大規模真實掃描 3D 數據庫,3D 對象建模的最新進展都依賴于合成數據集。

為了推動現實世界 3D 感知、重建和生成的最新技術,我們提出了一個大詞匯量的 3D 對象數據集,其中包含大量高質量的真實掃描 3D 對象。

它有幾個吸引人的特點:1)數據量非常大:包括190個日常類別的6000個掃描物體,與流行的2D數據集(如和LVIS)共享共同類別,有利于追求通用的3D表示。2)注釋豐富:每個3D物體都由2D和3D傳感器捕獲,提供紋理網格、點云、多視圖渲染圖像和多個真實捕獲的視頻。3)逼真的掃描:專業掃描儀支持高質量的物體掃描,形狀精確,外觀逼真。

利用提供的廣闊探索空間,研究人員精心設立了四個評估基準:a) 強大的 3D 感知、b) 新穎的視圖合成、c) 神經表面重建和 d) 3D 物體生成。

4. :for Field 上的

作者:陳,,Peter,

機構:谷歌、西蒙弗雷澤大學、多倫多大學

論文地址:

神經輻射場 (NeRF) 在從新視角合成 3D 場景圖像方面表現出了令人印象深刻的能力。然而,它們依賴于專有的體積渲染算法,而這些算法與廣泛部署的圖形硬件的能力不匹配。

本文介紹了一種基于紋理多邊形的新型 NeRF 表示,可用于使用標準渲染管道高效合成新圖像。NeRF 表示為一組多邊形,其紋理表示二進制不透明度和特征向量。使用 Z 緩沖區對多邊形進行傳統渲染會產生每個像素都具有特征的圖像,這些特征由片段著色器中運行的小型、視圖相關的 MLP 進行解釋,以產生最終的像素顏色。

這種方法使得 NeRF 能夠使用傳統的多邊形光柵化管道進行渲染,從而提供大量像素級并行性并實現足以在包括移動電話在內的各種計算平臺上進行交互使用的幀速率。

5. :基于圖像

作者:Li, Wang, Cole, Noah

組織:、康奈爾科技

論文地址:

在本文中,研究人員提出了一種基于體積圖像的渲染框架,該框架通過以場景運動感知的方式聚合附近的視點特征來合成新的視點。

研究人員的系統保留了以前方法的優勢,即能夠模擬復雜場景和視點相關效果,但也能夠從具有復雜場景動態和不受約束的相機軌跡的長視頻中合成照片般逼真的新視點。

結果表明,新方法在動態場景數據集上比 SOTA 有顯著改進。此外,它還可以應用于具有挑戰性的體育視頻,而之前的方法無法在這些視頻中產生高質量的渲染。

6.-

作者:胡一涵、楊、陳力、李克宇、司馬、朱、柴思齊、杜、林、王、盧樂偉、賈、劉強、戴、喬宇、李

單位:上海市人工智能實驗室自動駕駛團隊、武漢大學、商湯科技

論文地址:

在本文中,研究人員提出了一種新的綜合框架——統一自動駕駛(UniAD)。通過將全棧駕駛任務整合到一個網絡中,該框架可以利用每個模塊的優勢,并從全局視角為代理交互提供互補的功能抽象。任務通過統一的查詢接口進行通信,從而促進彼此的規劃。

研究人員在具有挑戰性的基準上實例化了 UniAD。消融實驗表明,新方法在各方面均顯著優于之前的 SOTA。

7. :精細文本轉圖像 -

作者:Ruiz、Li、Varun、Yael、Kfir

組織:、波士頓大學

論文地址:

在這項工作中,研究人員提出了一種“個性化”文本到圖像擴散模型的新方法。

只需輸入幾張主題圖片,預先訓練好的文本轉圖像模型就可以進行微調,學習將唯一標識符綁定到特定主題。一旦主題嵌入到模型的輸出域中,唯一標識符便可用于合成該主題在不同場景中的新照片級逼真圖像。

通過利用模型中嵌入的語義先驗以及新穎的自生成的類特定先驗保留損失,新方法能夠合成參考圖像中不存在的各種場景、姿勢、視點和光照條件下的主體。

8. 關于

作者:孟羅賓、高瑞琪、Ermon、Ho、Tim

機構:斯坦福大學、AI、慕尼黑大學、谷歌

論文地址:

沒有分類器指導的擴散模型的一個缺點是它們在推理時計算成本很高,因為它們需要評估兩個擴散模型(一個是類條件的,一個是無條件的),數十到數百次。

為了解決這一限制,研究人員提出了一種方法,將沒有分類器指導的擴散模型細化為快速采樣模型。

給定一個沒有分類器指導的預訓練模型,我們首先學習一個單一模型來匹配組合條件和非條件模型的輸出,然后逐漸將該模型細化為需要更少采樣步驟的擴散模型。

9. :

作者:古普塔,

機構:艾倫人工智能研究所

論文地址:

研究人員提出了一種神經符號方法,根據自然語言指令解決復雜和組合的視覺任務。

我們利用大型語言模型的非文本學習能力來生成類似于的模塊化程序,然后執行這些程序以獲得解決方案和全面、可解釋的理由。

生成的程序的每一行都可以調用幾個現成的 CV 模型、圖像處理子程序或函數之一來產生中間輸出。

研究人員在四項不同的任務上展示了它們的靈活性:組合視覺問答、圖像對的零樣本推理、事實知識對象標記和語言引導的圖像編輯。

研究人員表示,像這樣的神經符號方法是一種令人興奮的途徑,可以輕松有效地擴展人工智能系統的覆蓋范圍,以服務于人們可能想要執行的長期復雜任務。

10. 人類能做什么?

作者: Nath、Ayan Kumar、Sain、Koley、Tao Hong、宋一哲

院校:薩里大學

論文地址:

素描具有極強的表現力,能夠捕捉主觀且精細的視覺線索。然而,目前對素描這種固有屬性的探索僅限于圖像檢索領域。

在論文中,研究人員試圖利用草圖的表現力,而不是物體檢測的基本視覺任務。

研究人員首先獨立提示了SBIR模型的素描和照片分支,基于CLIP的泛化能力,構建了高度可泛化的照片編碼器。

隨后,研究人員設計了一個訓練范例,以使編碼器適應物體檢測,使得檢測到的邊界區域的嵌入與 SBIR 草圖和照片的嵌入對齊。

通過在標準對象檢測數據集(例如 -VOC 和 MS-COCO)上評估最新框架,結果表明它們在零樣本設置中優于監督(SOD)和弱監督對象檢測器(WSOD)。

11. 事件數據

作者:Nico Fang

機構:蘇黎世大學

論文地址:

現有的事件相機特征跟蹤方法要么是手工制作的,要么是從第一原理推導出來的,但需要大量的參數調整,對噪聲敏感,并且由于未建模的影響而無法推廣到不同的場景。

為了解決這些缺陷薩里大學,研究人員引入了第一個數據驅動的基于事件的相機特征跟蹤器,該跟蹤器利用低延遲事件來跟蹤在灰度幀中檢測到的特征。

通過無縫地將合成數據直接轉換為真實數據,新的數據驅動跟蹤器在相對特征年齡方面的表現比現有方法高出 120%,同時還實現了最低的延遲。通過使用新的自監督策略將跟蹤器調整到真實數據,這一性能差距進一步擴大到 130%。

12.

作者:Azim, Irina, Yury, Dehua Song,

機構:華為諾亞方舟實驗室

論文地址:

研究人員引入了一個新的深度神經網絡家族。研究人員不再使用傳統的 N 維權重張量來表示網絡層,而是使用沿濾波器和通道維度的連續層表示。研究人員將這種網絡稱為積分神經網絡 (INN)。

具體來說,INN 的權重表示為在 N 維超立方體上定義的連續函數,而每層輸入的離散變換相應地由連續積分運算取代。

在推理過程中貝語網校,可以通過數值積分和求積將連續層轉換為傳統的張量表示。這種表示允許網絡以任意大小和各種離散化間隔離散化積分核。

該方法可用于直接在邊緣設備上修剪模型,無需任何微調,即使在高修剪率下也只會造成很小的性能損失。

為了評估所提出方法的實際效果,研究人員使用各種神經網絡架構在多項任務上進行了實驗。

報告的結果表明,所提出的 INN 實現了與傳統離散 INN 相同的性能,同時能夠在高修剪率(高達 30%)下保持大致相同的性能(準確度損失 2%)而無需微調,而傳統修剪方法在相同條件下會遭受 65% 的準確度損失。

參考: